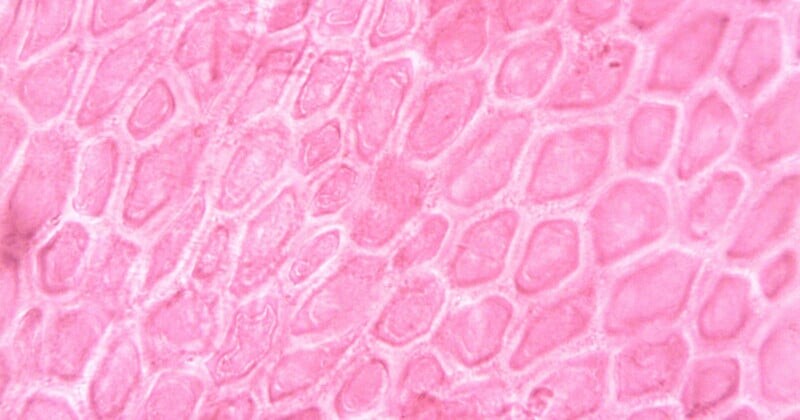

Недавнее исследование привлекло внимание к новым угрозам в медицинских исследованиях, связанным с использованием искусственного интеллекта для создания фальшивых микроскопических изображений. Эксперты предупреждают, что такая практика может подорвать научную целостность и привести к серьезным последствиям для медицины.

Исследовательская работа, опубликованная в журнале Nature, выражает беспокойство по поводу сложности проверки достоверности гистологических изображений, представляющих собой микроскопические виды тканевых образцов. В рамках исследования 816 студентов из немецких университетов тестировались на способности отличать реальные изображения от тех, что были сгенерированы искусственным интеллектом. Из 290 участников, не имевших опыта работы с гистологией, лишь 55% смогли правильно идентифицировать настоящие изображения. Среди 526 студентов с предыдущим опытом этот показатель увеличился до 70%.

Соведущий исследования, нефролог Ральф Мровка, отметил: "Я был действительно удивлен тем, насколько легко можно сгенерировать изображения, которые выглядят как настоящая гистология". Авторы работы утверждают, что растущая сложность инструментов генерации изображений на базе ИИ затрудняет идентификацию мошеннических данных с помощью традиционных методов. Существующее программное обеспечение для детекции может выявлять признаки манипуляции, такие как дублирование или сплайсинг изображений, но менее эффективно против полностью сгенерированного контента.

Для борьбы с угрозой подделанных изображений Мровка и его коллеги рекомендуют более строгие требования к научным журналам, включая представление необработанных данных. "Я думаю, что порог для публикации статьи с поддельными данными значительно выше, если вам нужно разместить эти фальшивые данные в их необработанном формате" – добавил соавтор исследования Ян Хартунг, нейролог из Университетской больницы Йены.

Мровка также отметил, что цифровые лабораторные журналы могут играть важную роль в обеспечении подлинности данных благодаря функции отметки времени. "Это было бы одной из мер, которая значительно усложнила бы возможность мошенничества". Технологические решения, такие как блокчейн, также могут обеспечить способы проверки происхождения данных. Энрико Буччи, биолог из Университета Темпл, подчеркивает его потенциал: "Вы можете отслеживать как источник, так и каждую ступень манипуляции изображением для сертификации того, что произошло с изображением с момента его создания". Тем не менее, пока остается неясным, примут ли научные издательства такие инструменты в широком масштабе. "Это определенно многогранная проблема" – заключает Хартунг.