Современные технологии искусственного интеллекта уже завоевали популярность в мире цифровой фотографии и видео. Одной из последних новинок стало средство для определения подделок, которое помогает разобраться, является ли содержимое видео созданным искусственным интеллектом или нет. В условиях, когда фальшивых медиа становится все больше, такая функция становится крайне важной.

Компания CloudSEK представила инструмент анализа подделок, помогающий определять подлинность видеофреймов, выявляя несоответствия, которые могут указать на использование ИИ.

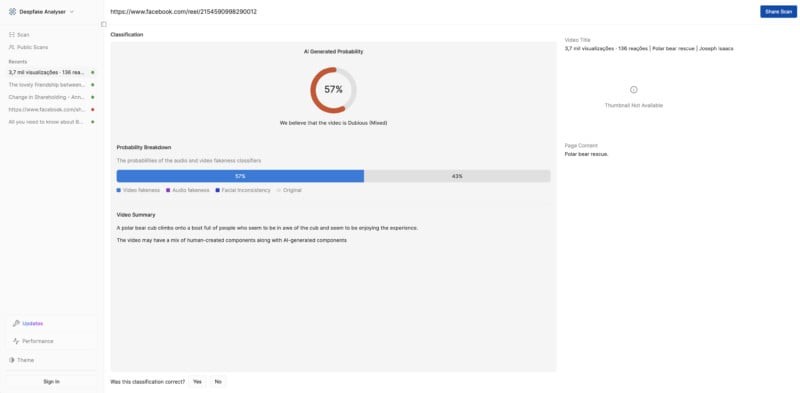

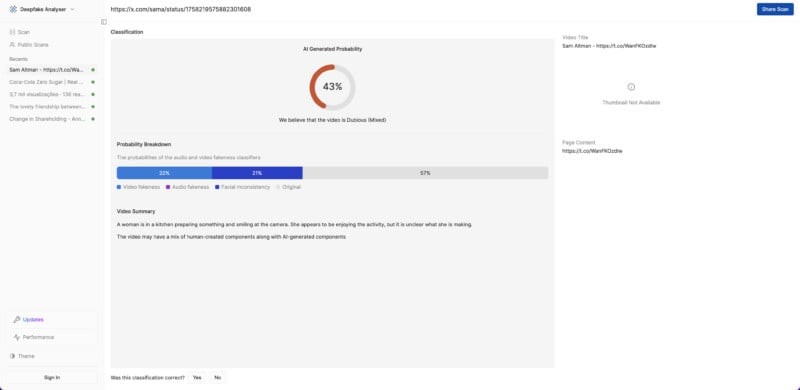

Тестирование показало, что этот инструмент довольно эффективен. Он оценивает видео на шкале от 0 до 100 процентов, где показатель 70% и выше говорит о том, что видео было создано ИИ, 40-70% - указывает на сомнительность, в то время как менее 40% сигнализирует о том, что контент, вероятно, был сделан человеком.

В качестве первого примера был выбран вирусный ролик с изображением полярного медвежонка, который «спасали» рыбаки на севере. Инструмент определил его подлинность с вероятностью 57%, что достаточно, чтобы всколыхнуть обсуждения вокруг его истинного характера.

Следующим на очереди стал новый видеоролик Coca-Cola, который был собственноручно «посвящен» рождественским праздникам. Инструмент определил вероятность подделки на уровне 35%, что зачастую говорит о том, что контент мог быть создан человеком. Вероятно, это связано с тем, что персонажи во видео были основаны на реальных актерах, что делает определение более сложным.

В финале тестирования была использована работа OpenAI, созданная для демонстрации кулинарных процессов. И хотя результат показал 43% вероятности, что это видео было сгенерировано искусственным интеллектом, оно также подтвердило актуальность использования подобных инструментов в креативной сфере.

Таким образом, инструменты анализа подделок становятся полезными для тех, кто хочет проверить, является ли визуальный контент подлинным, что может значительно упростить работу фотографов и видеографов в мире, насыщающемся искусственно созданным контентом.